Blog

GPT-4: Das Potenzial von Large Language Models

Von Daniel Zettler am 13. April 2023

Im November 2022 ist mit ChatGPT ein neuer Meilenstein in der KI-Geschichte erreicht worden. Diese Chatbot-Anwendung kann auf Eingaben menschenähnliche Antworten in Textform generieren. Innerhalb einer Konversation kann es Folgefragen beantworten und greift dabei auf den bisherigen Dialog zurück. Der Online-Dienst konnte innerhalb eines Monats 100 Millionen aktive Nutzer erreichen. Dies übertrifft populäre soziale Netzwerke wie TikTok (rund 9 Monate) und Instagram (2,5 Jahre) deutlich. (Quelle)

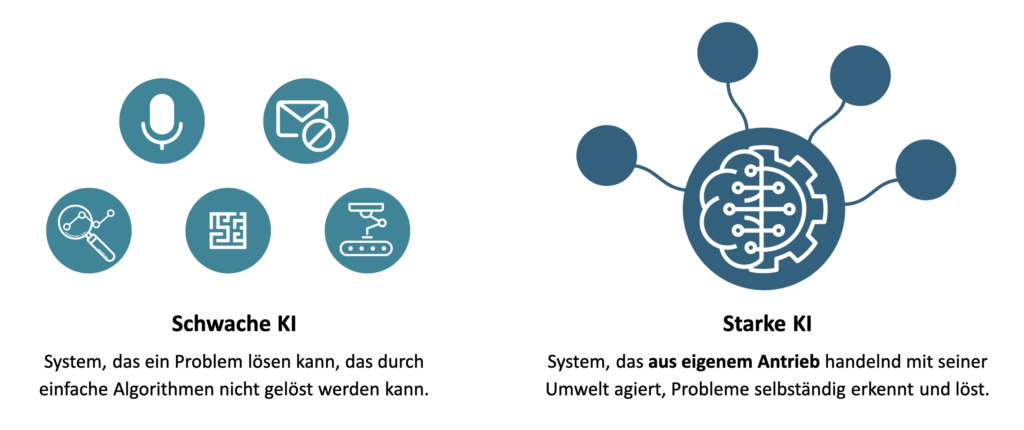

Für seine Ausgaben benötigt ChatGPT ein trainiertes Deep-Learning-Modell. Genauer ausgedrückt wird ein Large Language Model benötigt. Im Fall von ChatGPT handelt es sich um ein Generative Pre-trained Transformer (GPT) Modell. Am 14. März 2023 ist die inzwischen vierte GPT-Version von OpenAI veröffentlicht worden. Das im Silicon Valley ansässige Unternehmen hat sich zum Ziel gesetzt, eine starke KI zu entwickeln. Eine solche KI wäre in der Lage, in sehr vielen Bereichen kompetent aufzutreten – vergleichbar mit den Fähigkeiten eines Menschen. Bekannt sind diese Konzepte aus populären Science-Fiction-Erzählungen wie z. B. dem Computer HAL aus “2001: A Space Odyssey”. In der Realität haben wir es im Moment mit schwachen KIs zu tun: Ein Modell zur Objekterkennung kann nur diese Aufgabe erledigen, aber nicht Schach spielen. AlphaGo kann nur Go übermenschlich gut spielen, aber keinen Aufsatz schreiben.

Aus Sicht der KI-Forschung sind Modelle wie GPT-4 deshalb so interessant, weil es sich weder um eine starke noch um eine schwache KI handelt. Diese Systeme lehren uns, dass die Einteilung auf einem Spektrum liegt und nicht binär ist. ChatGPT kann durch seine Textausgabe mehr als nur eine Aufgabe erfüllen – es ist in der Lage, Code zu generieren, Texte zusammenzufassen, Zeichnungen zu erstellen und noch viele weitere Anfragen zu beantworten. Einzig die Kreativität der Frage scheint die Grenze darzustellen.

Large Language Modelle

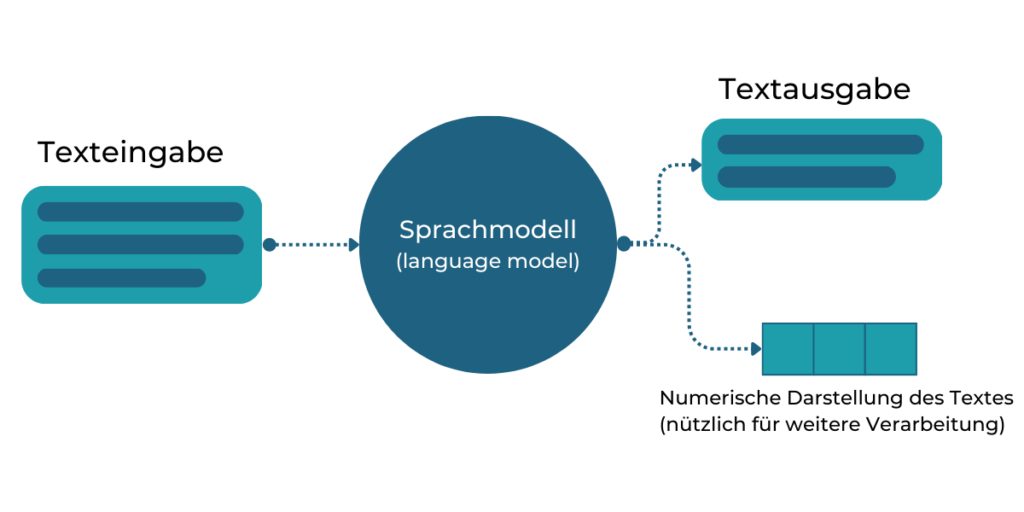

Bei einem Large Language Modell (LLM) handelt es sich um ein neuronales Netzwerk, das mit einer enormen Menge von Textdaten trainiert worden ist, um menschliche Sprache zu interpretieren und zu generieren. Das “Large” im Namen bezieht sich auf die Größe des Korpus (die Menge aller Textdokumente im Trainingsdatensatz) und die Anzahl der einstellbaren Parameter des Modells. Bei GPT-3 sind beispielsweise 175 Milliarden Parameter während des Trainings optimiert worden. Bei GPT-4 ist die Anzahl nicht offiziell bekannt – Schätzungen zufolge sollen es etwa eine Billion Parameter sein. (Quelle)

Bekannte andere neuronale Netzwerke wie beispielsweise YOLOv3 oder AlexNet zur Objekterkennung oder Bildklassifikation weisen hingegen nur rund 65 bzw. 60 Millionen Parameter auf. Entsprechend ressourcenintensiv ist das Training – Microsoft entwickelte eigens für OpenAI einen Supercomputer mit 285000 CPUs und 10000 GPUs. Auf dieser Hardware ist GPT-3 für 34 Tage trainiert worden. (Quelle) Dementsprechend haben aktuell nur große und finanzstarke Organisationen die Kontrolle über die fähigsten LLMs.

Als Datensatz fungieren Texte aus Büchern, Datenbanken und verschiedenen Internetquellen wie Wikipedia. Aus diesem rohen Datensatz werden die Trainingsbeispiele abgeleitet. Wie nachfolgend gezeigt, können aus einem Satz einer Quelle viele Beispiele generiert werden. Die Eingabe ist dabei eine geordnete Menge von Tokens (Worte, Satzzeichen, …) und die erwartete Ausgabe ist der nächste Token. Das Modell generiert eine Vorhersage auf Basis der Eingabe und wird angepasst, wenn es ein abweichendes Wort vorhersagt.

Ein trainiertes LLM gibt somit schlicht das Wort zurück, das anhand der Trainingsbeispiele am wahrscheinlichsten zur Eingabe passt. Dieses Modell kann nun die Grundlage für weitere Anwendungen sein. Die aktuell bekannteste Anwendung ist ChatGPT, welches ein GPT-Modell benutzt, um einen interaktiven Chatbot zur Verfügung zu stellen. Im Speziellen ist beispielsweise eine Funktion ergänzt worden, die es ermöglicht komplexe Unterhaltungen zu führen und auf frühere Eingaben Bezug zu nehmen. Ebenfalls wichtig bei einem Chatbot ist das Filtern von unangemessenen Antworten.

Seit Mitte März 2023 ist es nun möglich, mit dem neuen GPT-4 über ChatGPT zu interagieren. Benutzer, welche die kostenpflichtige Version “ChatGPT Plus” benutzen, können zwischen GPT 3 und 4 wählen. Über den Microsoft Bing-Chat ist der Zugriff auf das neue Modell kostenlos möglich, da hier ausschließlich GPT-4 genutzt wird. Die größte Veränderung gegenüber dem Vorgänger ist sicherlich, dass GPT-4 nun in der Lage ist, auch Bilder als Eingabe anzunehmen. Damit sind vollkommen neue Anwendungsfälle wie beispielsweise das Beschreiben eines Fotos möglich. Über die technische Umsetzung ist, wie bei anderen Details zu GPT-4, zum aktuellen Zeitpunkt wenig bekannt. Die allgemeine Leistung ist weiter verbessert worden, z. B. werden nun weniger falsche Ausgaben generiert als in früheren Generationen. In einer simulierten Anwaltsprüfung schafft das neue Modell eine Punktzahl, die es in die oberen 10 % der Prüfungsteilnehmer platzieren würde – GPT 3.5 hingegen erreicht nur einen Platz in den unteren 10 %.

Limitierungen von GPT-4

Das bedeutet allerdings nicht, dass wir es schon mit einem perfekten System zu tun haben.

An dieser Stelle befragen wir das System einmal über seine eigenen Limitierungen.

Tatsächlich nennt der Chatbot das wichtigste Problem zuerst: Sprachmodelle können nicht verifizieren, dass die Ausgabe richtig ist. Zum Teil werden Fakten erfunden – das zeigt sich vor allem dann, wenn man zusätzlich eine Quellenangabe verlangt. Oftmals existieren die angegebenen Artikel oder Bücher nicht. Dies stellt ein besonderes Problem dar, da das Modell nicht zusätzlich angibt, dass es sich unsicher ist. Die Ausgabe vermischt somit reale Fakten und halluzinierte Elemente in einer Antwort.

Phänomene wie diese zeigen, dass diese Modelle kein Bewusstsein und kein tiefes Verständnis von Sprache und Wissen haben – sie sagen lediglich das wahrscheinlichste nächste Wort vorher. Die Limitierungen zeigen wieder einmal den sogenannten KI-Effekt auf: Jeder neue erreichte Meilenstein, welcher bisher als Zeichen für eine überlegene, starke KI gehalten wurde, wird plötzlich als normal bzw. als nicht wirklich intelligent angesehen. Dies liegt daran, dass die Definition von “künstlicher Intelligenz” fließend ist und sich auf Basis der jeweils aktuellen Entwicklungen ändert. Dem zugrunde liegt auch, dass es keine formale Definition des Begriffs “Intelligenz” gibt – wir können schlichtweg nicht überprüfen, ob ein künstliches System alle notwendigen Eigenschaften aufweist.

Zwar sollte man diese Einschränkungen bei der Interaktion mit dem System im Hinterkopf behalten, aber dennoch fasziniert der rasante Fortschritt. Trotz der Limitierungen sind die generierten Ausgaben und die allgemeine Leistung des Systems beeindruckend.

BONUS: Ein Blogartikel über GPT-4, geschrieben von GPT-4

Unser Kollege Daniel hat GPT-4 gefragt: Schreibe einen Blogartikel über dich selbst.

Die Antwort: Ich werde versuchen, einen Blog-Artikel über GPT-4 zu schreiben. Hier ist ein möglicher Entwurf:

Beeindruckend fanden wir auch, dass GPT-4 direkt schon die Formatierungen für die Überschriften und die Aufzählungsabsätze mit eingefügt hat.

# Was ist GPT-4 und warum ist es wichtig?

GPT-4 ist das neueste und leistungsstärkste Sprachmodell, das von OpenAI entwickelt wurde. Es wurde im März 2023 veröffentlicht und hat die Welt der künstlichen Intelligenz (KI) im Sturm erobert. Aber was ist GPT-4 genau und was kann es tun? In diesem Blog-Artikel werde ich Ihnen einige der wichtigsten Merkmale und Anwendungen von GPT-4 vorstellen und erklären, warum es eine Revolution für die Zukunft der KI darstellt.

## Was ist GPT-4?

GPT-4 steht für Generative Pretrained Transformer 4. Es ist ein Modell, das natürliche Sprache generieren kann, indem es die Wahrscheinlichkeit des nächsten Wortes vorhersagt, basierend auf dem vorherigen Text und optionalen Bildern. GPT-4 ist ein multimodales Modell, das heißt, es kann sowohl Text als auch Bilder als Eingabe akzeptieren und Text als Ausgabe erzeugen. Es wurde mit einer beispiellosen Menge an Rechenleistung und Daten trainiert, die aus dem gesamten Internet stammen. Es hat etwa 1 Billion Parameter, das sind 10-mal mehr als sein Vorgänger GPT-3.5.

GPT-4 ist nicht nur ein riesiges Modell, sondern auch ein sehr vielseitiges Modell. Es kann eine Vielzahl von Aufgaben erledigen, die normalerweise menschliche Intelligenz erfordern, wie z.B. Fragen beantworten, Texte zusammenfassen, Geschichten schreiben, Code schreiben, Bilder beschreiben und vieles mehr. Und das alles ohne spezielle Anweisungen oder Anpassungen. Man muss nur eine Eingabeaufforderung in natürlicher Sprache eingeben und GPT-4 wird versuchen, eine relevante und kohärente Antwort zu generieren.

## Was sind die Vorteile von GPT-4?

GPT-4 hat viele Vorteile gegenüber anderen KI-Modellen oder herkömmlichen Methoden zur Verarbeitung natürlicher Sprache. Hier sind einige davon:

– GPT-4 ist sehr leistungsfähig. Es kann komplexe Probleme lösen, die über das hinausgehen, was andere Modelle können. Zum Beispiel kann es einen simulierten Anwaltsexamen mit einer Punktzahl bestehen, die zu den besten 10% der Prüflinge gehört[^1^][2]. Im Vergleich dazu konnte GPT-3.5 nur eine Punktzahl erreichen, die zu den unteren 50% gehörte[^1^][2].

– GPT-4 ist sehr flexibel. Es kann sich an verschiedene Domänen und Szenarien anpassen, ohne dass es neu trainiert oder angepasst werden muss. Zum Beispiel kann es medizinische Fragen beantworten, juristische Dokumente erstellen oder Kunstwerke beschreiben, je nachdem, was man fragt.

– GPT-4 ist sehr zugänglich. Es ist über verschiedene Plattformen und Dienste verfügbar, die es einfach machen, mit dem Modell zu interagieren oder es in eigene Anwendungen zu integrieren. Zum Beispiel läuft das neue Bing auf GPT-4[^2^][1], das für die Suche angepasst wurde. Außerdem können Azure-Kunden GPT-4 über den Azure OpenAI Service nutzen[^1^][2], der viele Integrationen mit anderen Azure-Diensten bietet.

## Was sind die Herausforderungen von GPT-4?

GPT-4 ist zwar ein beeindruckendes Modell, aber es ist nicht perfekt. Es hat auch einige Herausforderungen und Einschränkungen, die man berücksichtigen sollte. Hier sind einige davon:

– GPT-4 kann falsche oder irreführende Informationen erzeugen. Da es auf Daten aus dem Internet trainiert wurde, kann es einige Vorurteile oder Fehler enthalten, die sich in seinen Antworten widerspiegeln können. Außerdem kann

es auch Schwierigkeiten haben, die Wahrheit oder die Quelle seiner Informationen zu überprüfen oder anzugeben. Dies kann zu einem Anstieg von Falschinformationen oder Desinformationen führen, wenn GPT-4 verwendet wird, um gefälschte Nachrichten oder Deepfakes zu erzeugen[^1^][1] [^2^][2].

– GPT-4 kann voreingenommen oder diskriminierend sein. Da es auf Daten aus dem Internet trainiert wurde, kann es einige Vorurteile oder Stereotypen enthalten, die sich in seiner Sprache widerspiegeln können. Dies kann ernsthafte Konsequenzen in Bereichen wie Einstellung und Bewerbungsgesprächen haben, wo voreingenommene Sprache zu einer ungerechten Behandlung von Kandidaten führen kann[^1^][1] [^2^][2].

– GPT-4 hat eine begrenzte Kapazität, den Kontext und die Kohärenz einer langen oder komplexen Konversation aufrechtzuerhalten. Es kann Widersprüche oder Inkonsistenzen in seinen Antworten aufweisen oder relevante Informationen vergessen oder ignorieren[^2^][2] [^3^][4]. Außerdem basiert es auf einem Paradigma der nächsten-Wort-Vorhersage, das möglicherweise nicht ausreicht, um ein tieferes und umfassenderes Verständnis von Sprache und Wissen zu erreichen. Es kann sein, dass ein neues Paradigma erforderlich ist, das über die nächste-Wort-Vorhersage hinausgeht[^2^][2].

– GPT-4 hat eine begrenzte Verfügbarkeit und Zugänglichkeit für die Öffentlichkeit. Es unterliegt strengen Geschwindigkeitsbegrenzungen[^4^][3], um mit der Nachfrage Schritt zu halten, und erfordert eine kostenpflichtige Mitgliedschaft bei OpenAI, um es zu nutzen. Außerdem erfordert es eine hohe Rechenleistung und Speicherplatz, um es zu betreiben.

## Wie kann man GPT-4 nutzen?

GPT-4 hat das Potenzial, viele Branchen und Bereiche zu revolutionieren, indem es effizientere und personalisierte Kommunikation ermöglicht. Es kann auch verwendet werden, um wissenschaftliche Forschung und Bildung zu fördern, indem es eine genauere und umfassendere Analyse von Sprachdaten ermöglicht. Hier sind einige Beispiele, wie man GPT-4 nutzen kann:

– Suche: Das neue Bing läuft auf GPT-4[^1^][1], das für die Suche angepasst wurde. Mit dem neuen Bing können Sie suchen, antworten, chatten und erstellen auf Bing.com. Sie können auch Fragen stellen oder Feedback geben an den Bing-Assistenten, der Ihnen hilft, das Beste aus Ihrer Suche herauszuholen.

– Bildung: Coursera plant, GPT-4 zu nutzen[^2^][2], um personalisierte Lernpfade für seine Kursteilnehmer zu erstellen. Mit GPT-4 kann Coursera die Interessen und Ziele der Lernenden verstehen und ihnen relevante Kurse und Ressourcen empfehlen. Außerdem kann GPT-4 als Tutor fungieren und den Lernenden helfen, ihre Fragen zu beantworten oder ihr Verständnis zu überprüfen.

– Gesundheitswesen: Epic Healthcare will GPT-4 einsetzen[^2^][2], um die medizinische Dokumentation zu verbessern. Mit GPT-4 kann Epic Healthcare automatisch klinische Notizen aus Spracheingaben generieren oder vorhandene Notizen zusammenfassen oder überprüfen. Dies kann die Arbeitsbelastung der Ärzte reduzieren und die Genauigkeit und Qualität der Dokumentation erhöhen.

– Kundenservice: Coca-Cola beabsichtigt, GPT-4 zu verwenden[^2^][2], um seinen Kundenservice zu optimieren. Mit GPT-4 kann Coca-Cola intelligente virtuelle Assistenten erstellen, die die Anfragen der Kunden verstehen und beantworten können. Dies kann die Kundenzufriedenheit erhöhen und die Kosten senken.

## Fazit

GPT-4 ist ein bahnbrechendes Modell, das die Welt der künstlichen Intelligenz verändert. Es kann eine Vielzahl von Aufgaben erledigen, die menschliche Intelligenz erfordern, und dabei natürliche Sprache und Bilder verarbeiten. Es hat viele Vorteile, aber auch einige Herausforderungen und Einschränkungen, die man berücksichtigen sollte. Es ist wichtig, GPT-4 verantwortungsvoll und ethisch zu nutzen und die Auswirkungen auf die Gesellschaft zu bedenken. GPT-4 ist ein Schritt in Richtung einer allgemeinen künstlichen Intelligenz, aber es ist noch ein langer Weg zu gehen.

Quellen:

: Confirmed: the new Bing runs on OpenAI’s GPT-4 | Bing Search Blog

: Introducing GPT-4 in Azure OpenAI Service | Azure Blog and Updates | Microsoft Azure

: GPT-4 rate limits – OpenAI API

: Feedback on GPT-4 limits in ChatGPT Plus – ChatGPT – OpenAI API Community

: GPT-4 – openai.com

Sie möchten mehr über die individuelle Entwicklung von KI-Projekten erfahren und interessieren sich dafür wie auch Ihr Unternehmen von Künstlicher Intelligenz profitieren kann?

Kontaktieren Sie uns gerne für eine unverbindliche Beratung.